[English]Nächster Sündenfall im Bereich AI-Training. Der US-Anbieter ZScaler ist gerade "aufgefallen", weil er die 500.000.000.000 täglichen logs auf Kundensystemen zum Training seiner AI-Systeme verwendet. Für ZScaler ist kein Problem erkennbar, Sicherheitsforscher halten es für eine Schnapsidee. Ergänzung: Und persönliche Kundendaten werden mit einer Armada von "Schatten-Providern" wie Marketing-Firmen geteilt.

[English]Nächster Sündenfall im Bereich AI-Training. Der US-Anbieter ZScaler ist gerade "aufgefallen", weil er die 500.000.000.000 täglichen logs auf Kundensystemen zum Training seiner AI-Systeme verwendet. Für ZScaler ist kein Problem erkennbar, Sicherheitsforscher halten es für eine Schnapsidee. Ergänzung: Und persönliche Kundendaten werden mit einer Armada von "Schatten-Providern" wie Marketing-Firmen geteilt.

Zscaler ist eine amerikanische Cloud-Sicherheitsfirma mit Hauptsitz in San Jose, Kalifornien. Sie bieten eine Zero-Trust-Plattform, die Organisationen bei der sicheren Transformation ihrer Netzwerke und Anwendungen für eine moderne, Cloud-basierte Welt unterstützt. Zscaler will Kunden vor Cyberangriffen und Datenverlusten schützen.

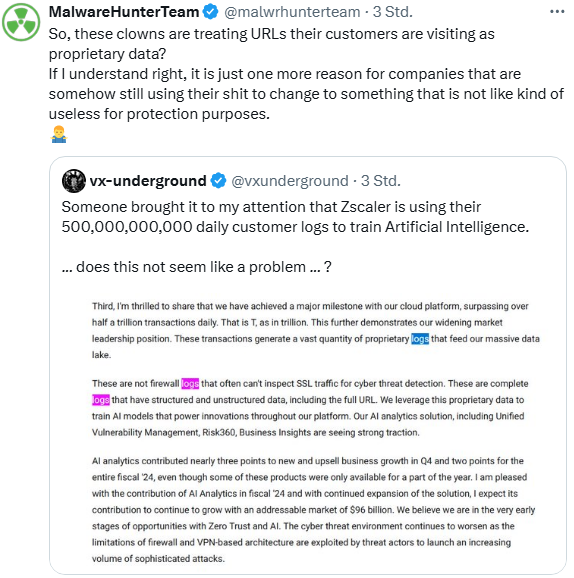

Ich bin durch obigen Tweet von MalwareHunterTeam auf den Sachverhalt gestoßen. Die schreiben "Also behandeln diese Clowns die URLs, die ihre Kunden besuchen, als proprietäre Daten? Wenn wir das richtig verstehen, ist das nur ein weiterer Grund für Unternehmen, die irgendwie immer noch ihren Mist verwenden, zu etwas zu wechseln, das nicht völlig nutzlos für Schutzzwecke ist." Nutzt jemand ZScaler?

Ergänzung: ZScaler hat inzwischen auf die Meldungen reagiert und diesen Artikel mit Erklärungen veröffentlicht. Es gibt hier einen Artikel vom 20. August 2025, der den Sachverhalt umfassender beleuchtet. Da bekommt Zero Trust gleich eine neue Bedeutung.

Nur die Spitze des Eisbergs?

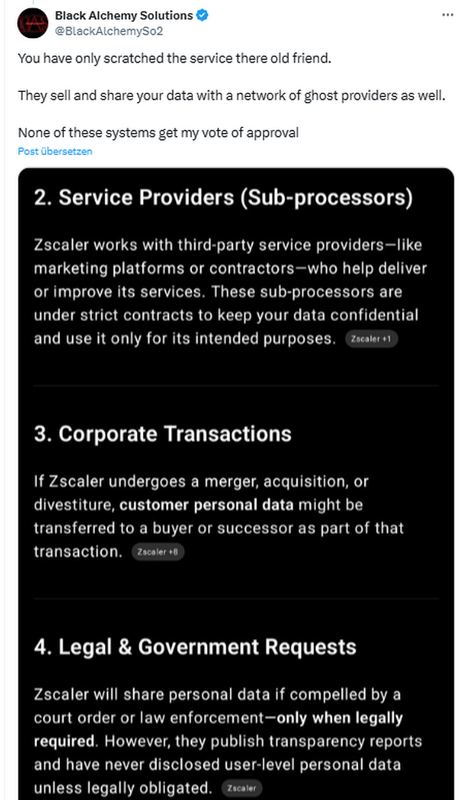

Ergänzung 2: Inzwischen hat jemand auf obigen Tweet geantwortet (danke an den Leserkommentar). Es ist wohl nur die Spitze des Eisbergs, der oben angesprochen wurde. Nachfolgender Tweet zeigt (Anhand der Terms of Service) den Abgrund:

Die Kundendaten, die ZScaler gewinnt, werden mit einem Netzwerk von "Schatten-Providern" (Marketing-Firmen etc.) geteilt. Bei einer ZScaler-Übernahme sollen Kundendaten an den Käufer übergehen. Das kann eigentlich kein europäisches Unternehmen, welches der DSGVO unterliegt, so akzeptieren.

Rückmeldung aus der Leserschaft

In den Kommentaren unten gibt es ja einige Bestätigungen der Nutzung. In einer Mail hat sich noch ein Leser gemeldet und merkte an, dass ZScaler flächendeckend bei Volkswagen (in allen Werken Deutschlands zumindest) eingesetzt wird, um ein Split-Tunneling im Home Office durchzuführen. Der Leser vermutet, auch um den Office365-Verkehr zu kanalisieren und komprimieren.

Er hat die Software seit dem ersten Tag auf seinem Arbeitsgerät deaktiviert, indem er den Dienst auf deaktiviert gestellt hat. Mit der Software sei alles noch langsamer als ohnehin schon. Wird aber nicht jeder Nutzer so tun können.

MVP: 2013 – 2016

MVP: 2013 – 2016

"… bieten eine Zero-Trust-Plattform, die Organisationen bei der sicheren Transformation ihrer Netzwerke und Anwendungen für eine moderne, Cloud-basierte Welt unterstützt. Zscaler will Kunden vor Cyberangriffen und Datenverlusten schützen …"

Naja, wenn ich "Zero Trust" ins Deutsche übersetze, kommt da "Null Vertrauen" heraus … trifft den Nagel dann wohl 100% auf dem Kopf …

Amerikanischen Firmen kann man wohl per se nicht vertrauen … Da wundert mich das ganz überhaupt nicht …

ja, wir zumindest in der GBU Germany

habs gleich mal an unseren DVA Vorsitz gemailt

danke

Ich kenne Kunden meines Arbeitgebers, die ZScaler als Cloudproxy verwenden. Zumindest bei einem dieser Kunden habe ich engeren Kontakt mit den IT-Verantwortlichen und werde einmal diesen Fall dort zur Sprache bringen.

Ich selbst habe ZScaler einmal bei einem dieser Kunden supportet. So etwas ist für mich ein NoGo und zeigt nur wieder, dass heutzutage Kunden als Datenquelle für weitere Dienste herangezogen werden.

> ZScaler nutzt Kunden-Logs zum AI-Training <

Peanuts! Einfach mal (1) durchackern, um zu erkennen, welche Nutzungsrechte sich Zscaler schon seit jeher ausbedungen hat. Wer aktuell aufschreit, hat zuvor Jahre geschlafen.

_

(1) https://help.zscaler.com/logs-fair-use/logs-data

Boah, wer liest das alles? (Genau das ist das Problem…) Ich glaube, ich nutze mal Copilot um das zusammen fassen zu lassen… *scnr*

Der feuchte Traum eines jeden Winkeladvokaten :c)

Aber schon interessant was da so unter "fair use" definiert wird! m(

Aha ..

"Er hat die Software seit dem ersten Tag auf seinem Arbeitsgerät deaktiviert, indem er den Dienst auf deaktiviert gestellt hat. Mit der Software sei alles noch langsamer als ohnehin schon. Wird aber nicht jeder Nutzer so tun können…"

ist eine Umgehung der Unternehmens-IT Sicherheit und damit in zahlreichen Unternehmumgen eine Richtlinienverletzung und daher ein Abmahngrund!

Schön, dass "Home Admins" solche eigenständige Entscheidungen treffen und umsetzen dürfen.

*Sarkasm off*

Sofern es ein Admin aus der IT war, müsste man in die Details schauen. Der normale Mitarbeiter wird i.d.R. keinen Dienst aktivieren können.

Es gibt Benutzer, die sind gleicher als gleich… Oder der Laden hat seine Workstations nicht fachgerecht gehärtet und versucht per zusätzlichem Schlangenöl und viel Geld aus dem Fernster werfen (kurz: zscaler kaufen) das auszugleichen.

korrekt (bzw. die Hoffnung stirbt zuletzt)… leider sind das aber gerade solche User, welche das größte Risiko (u. a. durch so eine Aktion) verursachen.

Zscaler ist teuer, das leistet sich kein kleines Unternehmen.

Wenn es ein Developer oder ähnliches mit Linux oder einem Mac ist, stellen sich bei sowas weitere Probleme… OWASP10, etc.

Wenn man als Mitarbeiter im Jahr 2025 die Sicherheit umgeht, weil es langsamer ist…. Oida, da fehlt einiges…

Eine KI wird ohne Daten keine KI werden. Was wollt Ihr? Es ist nun mal mehr als logisch, dass "Echtdaten" benutzt werden müssen, was sonst? Klar hat das auch Nachteile, aber wer nach Datenschutz schreit, würgt zugleich die KI-Entwicklung ab. Ich vermute das persönliche Daten anonymisiert werden.

Sorry, die Firmen verdienen so einen Vertrauensvorschuss nicht. Wenn die ihre KIs mit "öffentlichen" Daten füttern ist das das eine. Aber explizit Kundendaten (Logs auf Kundensystemen sind für mich Kundendaten) ohne deren direkte, aktive Einwilligung dafür zu benutzen geht gar nicht. Und nein, sowas in irgendwelchen Dokumenten mit unterzubringen ist für mich keine aktive Zustimmung.

Und das die Daten anonymisiert werden kannst du gerne vermuten, aber kannst du das kontrollieren?

Und was das Thema "wer nach Datenschutz schreit, würgt zugleich die KI-Entwicklung ab." angeht: Das hat die selbe Qualität wie die Argumente für immer mehr Überwachung der Bürger, da wird auch gerne argumentiert, dass es für die Sicherheit unbedingt nötig ist.

Betr. "Und nein, sowas in irgendwelchen Dokumenten mit unterzubringen ist für mich keine aktive Zustimmung.":

[ ] Du weisst wie Verträge geschlossen werden.

Ich wage doch sehr zu bezweifeln, dass in den Verträgen deutlich drin steht "Hey, wir werden übrigens alle eure Log-Daten benutzen um unsere KI zu füttern."

Da wird dann wohl eher auf 700 Seiten EULA o.ä. verwiesen, wo das dann vielleicht irgendwo drin steht.

Aktive Zustimmung wäre für mich, wenn bei der Installation/Konfiguration der Software ein Feld existiert, wo man einschalten kann, dass man die Daten teilen möchte. Das darf dann aber kein Pflichtfeld sein (ala du kannst unsere Software nur nutzen wenn du das zustimmst) und per default aus sein, also Opt-In. Dann kann ja die Firma selbst entscheiden, ob sie das wollen.

Wir nutzen auch Zscaler und bin damit eigentlich ganz zufrieden. Die Ersteinrichtung hat einiges an Zeit gekostet, aber nun läuft's eigentlich rund.

> Ich vermute das persönliche Daten anonymisiert werden.

Mutmaßungen helfen nicht weiter! Und Anonymisierung? Dann sind wir wieder beim Datenschutz. Weil dann sind die Daten ja unnütz. Bzw. könnten unnütz sein.

Auch anonymisierte Daten können interessant sein. Musst dich halt mal informieren, was zscaler mit KI macht, und was anonymisierte Log-Daten da für einen Vorteil beim Training der Anwendung haben könnten…

Daten sind Gold und so sollen sie dann auch bezahlt werden. Nicht still heimlich und leise abgezogen und verwendet

Der war gut. Aber Satire bitte trotzdem kennzeichnen.

Jetzt mal ehrlich und Butter bei die Fische: Welche KI Firma nutzt den nicht eure Daten, müssten die all die genutzen Daten für ihr LLM ordentlich lizenzieren, wäre mehr als die Hälfte pleite!

KI Firmen können das halt ziemlich ungeniert da man es kaum beweisen kann… ziehe ich mir einen Kinofilm runter ist die Urheberverletzung eindeutig bei KI eben nicht.

@TBR

Die dürfen gerne meine Daten verwenden, nur eben nicht einfach "geklaut"… kannst gerne meine Datensätze lizenzieren! Die ContentMAFIA kennt ja die Spielregeln: JE nach Art der Datensätze kostet es halt mal mehr mal weniger (und manches sind halt Mondpreise)! Du kaufst die Daten auch nicht wirklich, sondern nur ein Nutzungsrecht an den Daten,das auch nur auf begrenzter Zeit und Widerruf meinrseits jederzeit möglich, für genau den einen Fall wo du bezahlst, Weitergabe oder andersweitige Verwendung ausgeschlossen. Abo möglich…

(inkl. Werbung, werbefrei kostet extra), ach ja und mit DRM bestimme ich wie wann und wo du die verwendest. Payed per view/abruf ;-P

Offers welcome ;-P

Tja Jungs diese Resource steht halt nicht den Firmen für den Raubbau zur Verfügung! Sondern ist meins!

Was ich noch immer und immer wieder frage…. Was sagt denn der BSI dazu? Oder jegliche andere Behörde, die beim Datenschutz schnell böse wird? Gibt es die noch? Oder ist es normal, dass sich Administratoren und verantwortliche mit genug Know-How hier und in anderen Foren einfach nur aufregen? Was ist mit dem Leak der Telekom geworden? Eine Woche Aufregung und das wars. Was ist mit dem Befund über den top Filter von Recall geworden? Fragen über Fragen…. Sind die Themen, die mir gerade so einfallen als Beispiele. Mit 37, somit schon alt und daher eher ein schlechtes Gedächtnis *hust

Normalität: Da wird ein, zwei Wochen die Sau durchs Dorf getrieben, und dann juckt das keinen mehr – ist doch spätestens seit Snowden bekannt. Die Gefahr besteht nur darin, dass irgendein übereifriger Politiker verschärfte Überwachung fordert, aka Vorratsdatenspeicherung und Co. Was unsere Politiker wirklich wollen, ist ein Überwachungsstaat, und deshalb kommt immer wieder mal ein Vorstoß.

Bisher haben wir aber ein prima Bundesverfassungsgericht, das seinen Job ordentlich macht! (Naja, fast ordentlich – denn es ist mir schleierhaft, wie Politiker, deren Gesetzesänderungen als demokratie-, verfassungs- und menschenrechtsfeindlich einkassiert wurden, weiterhin im Amt sein dürfen.)

Übereifrige Datenschutzbeauftragte werden auch gerne mal des Amtes enthoben oder von der EU-Kommission verklagt. 🔗 Streit über Microsoft 365: EU-Kommission verklagt EU-Datenschutzbeauftragten 🔗 DSGVO: Bundesregierung klagt gegen ihren Datenschutzbeauftragten

„Echter" Datenschutz ist nicht gewünscht! Die DSGVO ist lediglich dazu da, den Mob ruhigzustellen … Du willst Datenschutz? Dann kümmer dich selbst drum!

PS: Hust – das Alter spielt keine Rolle dabei … Ich bin weitaus älter und habe trotzdem ein gutes Gedächtnis. Entscheidend ist, dass man das nutzt, was auf dem Hals steckt. ;-P

Mein Problem ist dabei eher der Kunde. Zum Kunden hin wird immer Datenschutz geprädigt. Das ist schlecht, dies ist böse. Hier musst du investieren, da musst du investieren.

Der Kunde argumentiert da anders. Der weiß das alle 365, OneDrive, cloud generell, etc. einsetzen. Die haben auch teils in diversen Foren gelesen, dass eine avm als Firewall ausreicht.

ZB. diverse FitnissStudios. Haben Sie Kameras, teils personallose Studios, wo die Tür und Geräte von extern überwacht werden. Klein-Büros ebenso.

Dann erzählt man von den ganzen Leaks und Schwachstellen. Firmen die wegen sowas Insolvenz gehen. Interessiert ja nicht, da dass wissen da ist, dass den Großen nicht interessiert und dort auch nichts passiert.

Wie kann es sein das die MS cloud vor 2-3 Jahren mehrfach infiltriert wurde, aber große Konzerne und tausende Firmen es dennoch nutzen.

Ich als Administrator geh da innerlich immer auf 180,bin aber völlig machtlos.

Jetzt kann einer sagen "Dann arbeite nicht mit den Kunden". Naja, dann hätte man unseren Laden von vor Jahren schließen müssen….

Ich hoffe mein Gedankengang kommt irgendwie rüber und wird ich es meine.

Wegen dem Gedächtnis, welches wohl unter dem Google-Symptom leidet: hier wurden halt schon so viele Sachen veröffentlicht, dass man sich gar nicht mehr an viele erinnert.

Naja Kunden die sich nicht helfen lassen wollen… kassiert man und lässt sie eben auflaufen. Geliefert wie bestellt!

Wichtig ist ich hab ausreichend beraten, wenn das dann ignoriert wird nicht meine Schuld.

Also meine Kunden sind nicht im IT Feld. Betreue aber einige Silversurfer. Die meisten verinnerlichen auch was ich ihnen sage und sind da eher übervorsichtig, sprich fragen lieber 2x nach bevor sie was machen Kann auch lästig sein da immer angerufen zu werden: du kann ich da bedenkenlos klicken). Anders die Jungspunde die meinen alles besser zu wissen weil sie meinen mit Youtube TikTok Fratzenbuch & Co. wissen sie wie es geht.

Tja letzten erst so ein Fall: Beim surfen zickt Rechner, PopUp: MS Support ihr System ist komprimiert bitte für weitere Hilfe folgende Nummer anrufen… tja was macht die Dummbratze genau das. Inder mit gebrochenem Deutsch überzeugt ne Software runterzuladen und ihm Zugriff zu geben… Ich mach es kurz Ende vom Lied Konto leergeräumt, über 120k€ weg.

Schlug flennend hier auf… hab ich weggeschickt und ihm gesagt er braucht sich bei mir nicht mehr zu melden soll zur Polizei!

Sorry aber manchen Leuten kann man eben nicht helfen! Dann lässt man sie es eben auf die harte Tour lernen, bin mir sicher der hat gelernt.

Wennn Schaden klug macht, dann las den Schaden maximal sein!

Kommt uns allen zu Gute.

Zurück zu deinem Beispiel, dann muss man den eben klar machen das "die Großen" eben Schäden in Millionenhöhe aus der Portokasse zahlen und fragt nach ob man das auch aus der Portokasse zahlen könne… und dann lässt man sie eben machen.

Mehr als ausreichend beraten/aufklären ist eben nicht drinn!

Hauptsache man hat sich da nix vorzuwerfen.

Aha, Silversurfer als Kunden. Jetzt kann ich dich einsortieren.

Ich bin im Bereich Konzern unterwegs. Früher per Dienstleister, irgendwann mal abgeworben worden. Hatte für beide Seiten Vorteile, für meinen ehemaligen AG natürlich nicht.

Aber ich kann dir sagen, wenn du als Dienstleister einem Firmenkunden sagst, er soll aus Sicherheitsgründen die MS/AWS/Google/…-Cloud nicht benutzen, dann war es das schlimmstenfalls mit der Dienstleistung. Wenn du pech hast, am Ende nicht mal Desksidesupport und Druckerpatronenwechsel im Konzern. Am Ende bleiben dir tatsächlich nur noch die Silversurfer.

Die Lemminge werden sich bestmöglich ruinieren – aber muss man freudig, naiv oder so dabei sein, wenn es über die Klippe geht?

ZScaler wird leider von ziemlich vielen größeren Firmen eingesetzt.

Richtig. Wichtig ist, dass man jetzt deren Datenschutz-Teams informiert, dass die aktiv werden.

Auch Adobe hat seine Position bzgl. Ai Training auf Customer Data auf Druck der Datenschutz-Teams von Konzernen angepasst.

Laut diesem Beitrag verkaufen sie auch alle Kundendaten an dritte:

https://x.com/blackalchemyso2/status/1958715904013082685

Danke, ich habe es im Text mit aufgegriffen – die Kundendaten gelangen also "in den Datenreichtum" und werden für Marketing-Firmen interessant.

Gut. Ich finde das wäre fast einen zweiten Artikel wert – es ist das eine, wenn Ki trainiert wird (NoGo). Es ist was anderes, wenn man Rohdaten von Kunden an Dritte verkauft (NoGo2). Ich kenne 3 deutsche Großkonzerne, denen war das nicht bewusst.